第二步:点击右下角齿轮图标,或者直接「Ctrl+,」快捷键打开应用程序设置界面。这里你可以将界面语言调整为中文。同时下拉滚动条找到Use LM Studio's Hugging Face Proxy选项,并在其左侧的方框里打勾选中。之后即可关掉应用程序设置界面。

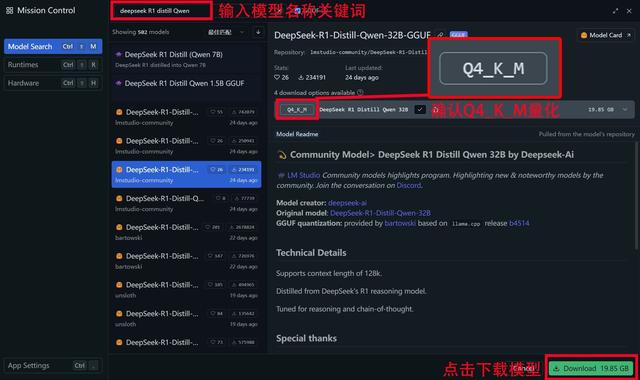

第三步:找到主界面左侧放大镜图标,也就是「发现」按钮,并点击打开模型搜索界面。

第四步:在搜索栏搜索「DeepSeek R1 Distill」相关的关键词。比如我们要下载「DeepSeek-R1-Distill-Qwen-14B」以及「DeepSeek-R1-Distill-Qwen-7B」两个大模型,直接搜索关键词,并找到对应大模型之后,点击右下角绿色的Download按钮,即可下载相应大模型。同时在弹出的下载界面里可以看到下载进度。此外,AMD官方推荐将所有Distill运行在Q4_K_M量化模式,所以在下载模型时需要从右侧详情栏中确认该模型是否是Q4_K_M量化模式。

「使用」

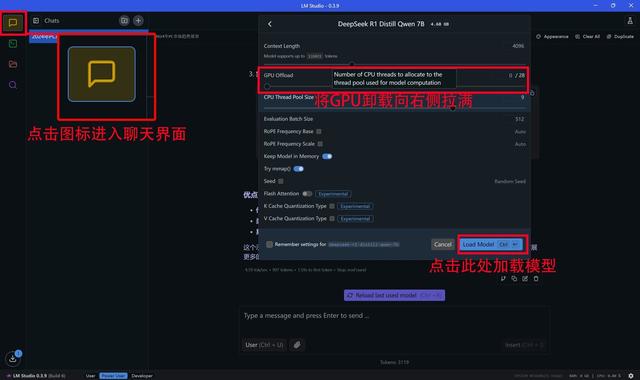

第三步:选择大模型之后会弹出设置菜单,这里我们把「GPU卸载」的条拉到最右侧,其它选项按需设定即可。

第四步:之后点击右下角的「加载模型」按钮等待模型加载完毕,即可使用DeepSeek R1 Distill大模型了。

·锐龙AI PC能否顺利运行DeepSeek?

最后我们看看锐龙AI PC能否顺利在本地运行DeepSeek?同时也可以看看它的运行速度到底怎样?

在与DeepSeek进行交互时可以看到,这项应用对GPU资源的占用非常高,几乎达到了100%,同时在内存占用方面会超过20GB,所以普通的8GB、16GB内存运行起来就非常吃力了。另外处理器的占用非常低,一般不到10%。

测试平台所搭载的GPU是AMD Radeon 890M iGPU,运行7B和14B规模的DeepSeek R1 Distill Qwen大模型实测是没有任何问题的,不过速度相比独立显卡自然是会慢上不少。但集成显卡AI PC能够在本地借助硬件算力跑起来14B规模的大模型,这在以往是难以想像的,可见Ryzen AI在算力方面的保障是极为出色的。

我让DeepSeek帮忙编写了一段“通过Enum枚举同一标签或一系列常量的集合”的代码,使用的大模型是DeepSeek-R1-Distill-Qwen-14B(7B精度相对比较低),前序的思考推理过程耗时为57.95秒,不算快,但考虑到我们使用的锐龙平台只有集成显卡,这个速度以硬件为参照坐标来说,其实已经是相当快了。

在完成整个推理互动过程之后可以看到,首个token生成时间为1.59秒,每秒可生成4.59个token,总计为907tokens。笔者大概看了一下生成的答案,并且请教了程序员同事,DeepSeek给出的答案非常准确。

此外,笔者还尝试让DeepSeek撰写了笔记本产品的评测脚本,分析了2025年PC市场发展趋势等等。整体来说前序思考推理时间基本在45秒-2分钟以内,有着不错的效率。这说明AMD Ryzen AI平台运行本地化的DeepSeek大模型是完全可行,且拥有不错体验的。

·结语

AI PC在经历了一年多的高速发展期之后,所面临的主要问题就是缺少“杀手级”应用,以及用户自主部署本地化AI应用时有着较高的门槛。反倒是在硬件端,其实AMD、NVIDIA这些厂商都已经提供了足够强大的算力支持。

2025开年DeepSeek的爆火,让更多大众用户认识到了当前人工智能是什么、怎么用,基于这一大模型所打造的AI应用,并不需要非常庞大的算力支持。尤其是通过本篇文章中测试就可以看出,AMD锐龙AI 9 HX PRO 375平台在仅有Radeon 890M iGPU的情况下,就能够在本地顺利且相对流畅地使用DeepSeek-R1-Distill-Qwen-7B/14B这样规模的大模型,足见锐龙AI PC是完全可以满足当前AI应用算力需求的。

此外可能有朋友会问,“为什么要部署本地化的AI?”

这个问题的答案其实用两个核心词就能概括——安全和便利。

本地化AI应用一方面为用户提供了无与伦比的私密性和安全性;另一方面又带来了不错的便利性,它让用户在没有网络的情况下也能够借助AI提升工作、学习效率。此外,相对于目前基本都要付费才能使用的AI应用来说,本地化部署的AI使用成本自然也更低。从AMD官方公布信息可以看到,现在单纯使用非独显的锐龙处理器平台,最高就可以支持到DeepSeek-R1-Distill-Llama-70B超大规模的大模型使用,这真的可以说是“黑科技”了。

(9490672)

VIP课程推荐

APP专享直播

热门推荐

收起

24小时滚动播报最新的财经资讯和视频,更多粉丝福利扫描二维码关注(sinafinance)