来源:DeepTech深科技

刚刚,阿里全新开源代码模型 Qwen3-Coder 正式发布。

Qwen3-Coder 拥有多个尺寸,此次发布的是最强大的版本,名为 Qwen3-Coder-480B-A35B-Instruct(以下简称 Qwen3-Coder)。

它是一款混合专家(MoE)模型,总参数量高达 4,800 亿,激活参数为 350 亿,原生支持 256K token 的上下文,并可通过 YaRN 扩展到高达 1 百万 token,支持 358 种编程语言。

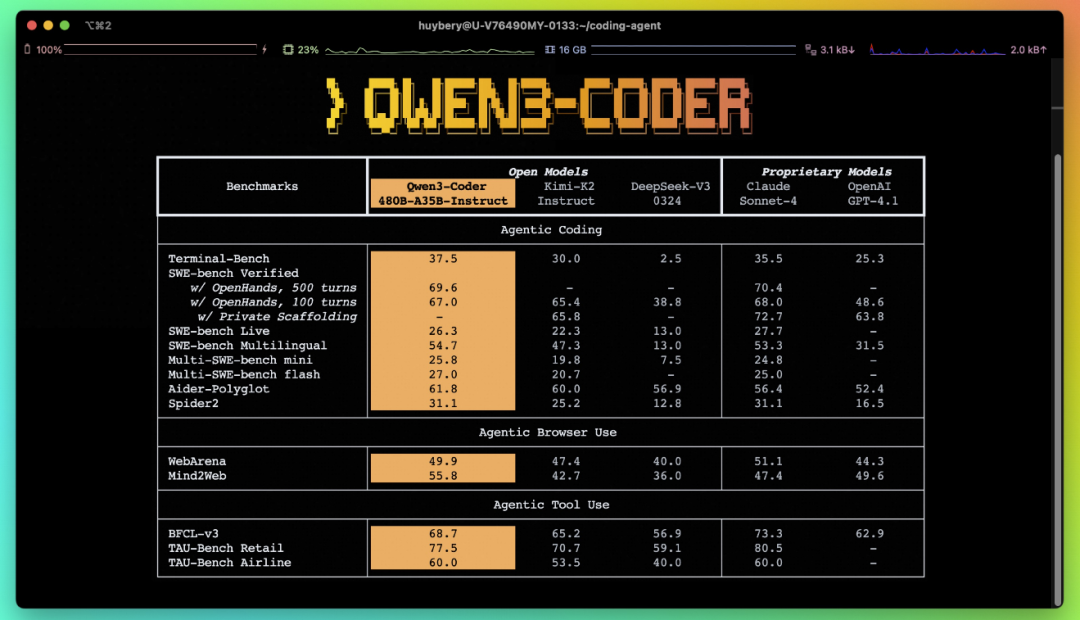

| Qwen3-Coder 在测试中的表现(来源:资料图)

由于 Qwen3 系列模型的整体调整,Qwen3-Coder 仅支持非思考模式,不生成思考过程。

在注意力机制方面,Qwen3-Coder 采用了分组查询注意力(GQA)方案,配备 96 个查询(Q)注意力头和 8 个键/值(KV)注意力头,并拥有 160 个专家(Expert),其中 8 个专家被激活。

| Qwen3-Coder 模型总览(来源:Qwen)

据介绍,预训练阶段,Qwen3-Coder 从数据、上下文、合成数据三个不同角度进行扩展(scaling),以提升模型的代码能力。

在后训练阶段,研究团队选择在更丰富的真实代码任务上扩展代码强化学习(Code RL)训练。通过自动扩展测试样例,他们构造了大量高质量的训练实例,成功释放了强化学习的潜力:不仅显著提升了代码执行成功率,还对其他任务带来增益。

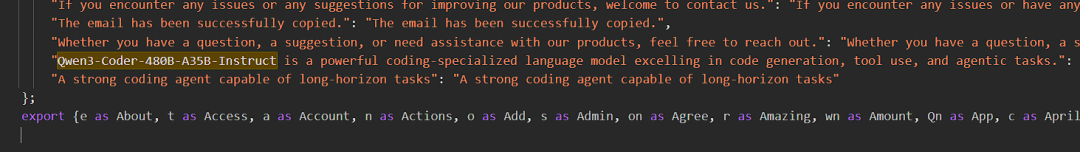

此前网友挖出线索,阿里团队在代码中介绍 Qwen3-Coder 时写道:“Qwen3-Coder-480B-A35B-Instruct 是一个强大的编码专用语言模型,在代码生成、工具使用和代理任务方面表现出色。”

| 网友先前挖出 Qwen3-Coder 的线索(来源:X)

阿里表示,该模型“拥有卓越的代码和代理能力”。Qwen3-Coder 在代理式编码、代理式浏览器使用和代理式工具使用上成为了开源模型的 SOTA,可以媲美 Claude Sonnet 4。

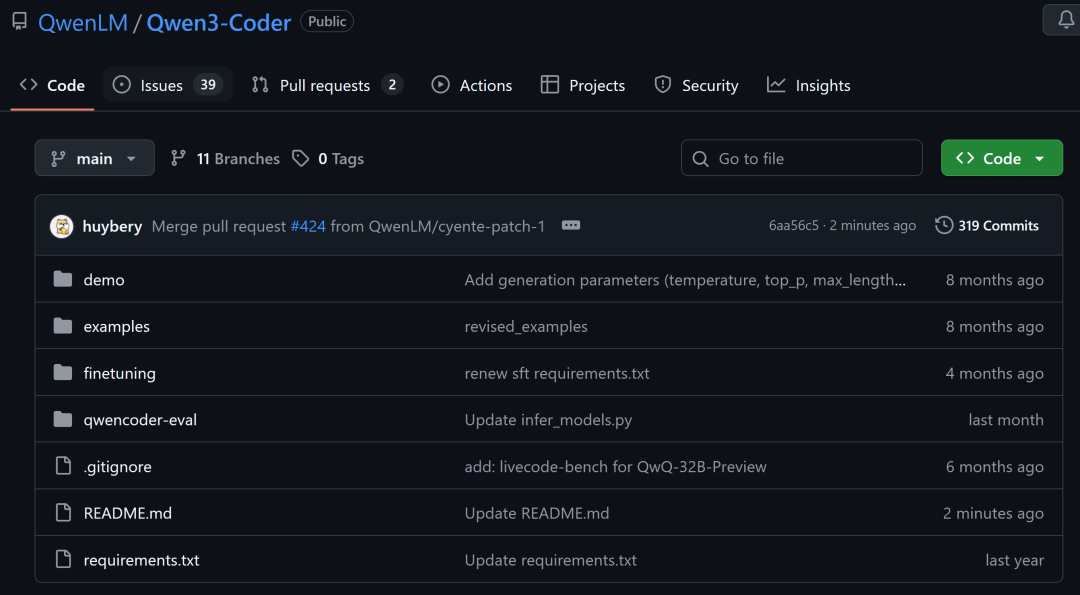

Qwen3-Coder 也是受到了网友的大力追捧,代码库上线一小时就收获了 5.1k Star。

| 代码库是 https://github.com/QwenLM/Qwen3-Coder(来源:GitHub)

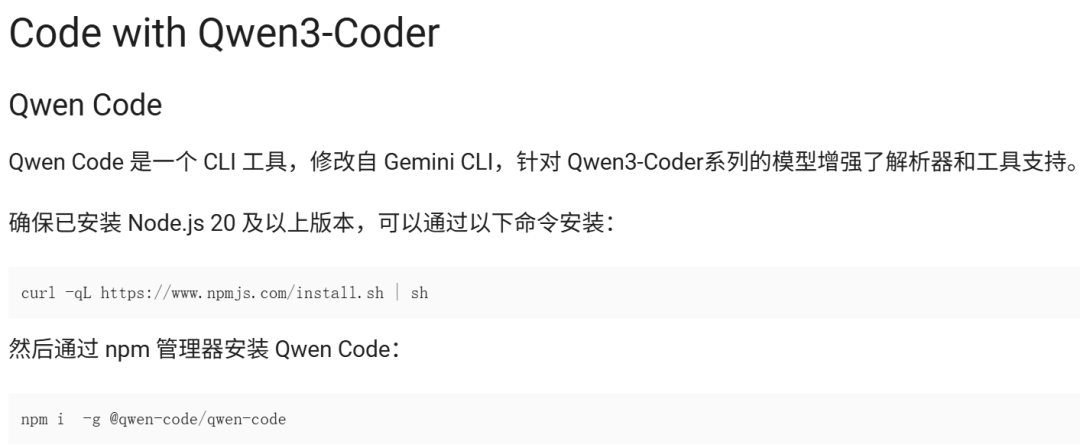

与此同时,阿里还推出并开源了一款用于代理式编程的命令行工具:Qwen Code。

“Qwen Code 基于 Gemini Code 进行二次开发,但我们进行了提示词和工具调用协议适配,使得 Qwen Code 可以最大程度激发 Qwen3-Coder 在代理式编程任务上的表现。”阿里在官网上表示。

另外,Qwen3-Coder 也可以和 AI 社区优秀的编程工具结合使用,如 Claude Code、Cline 等。开发者也可以通过阿里云 Model Studio 调用 Qwen3-Coder API。

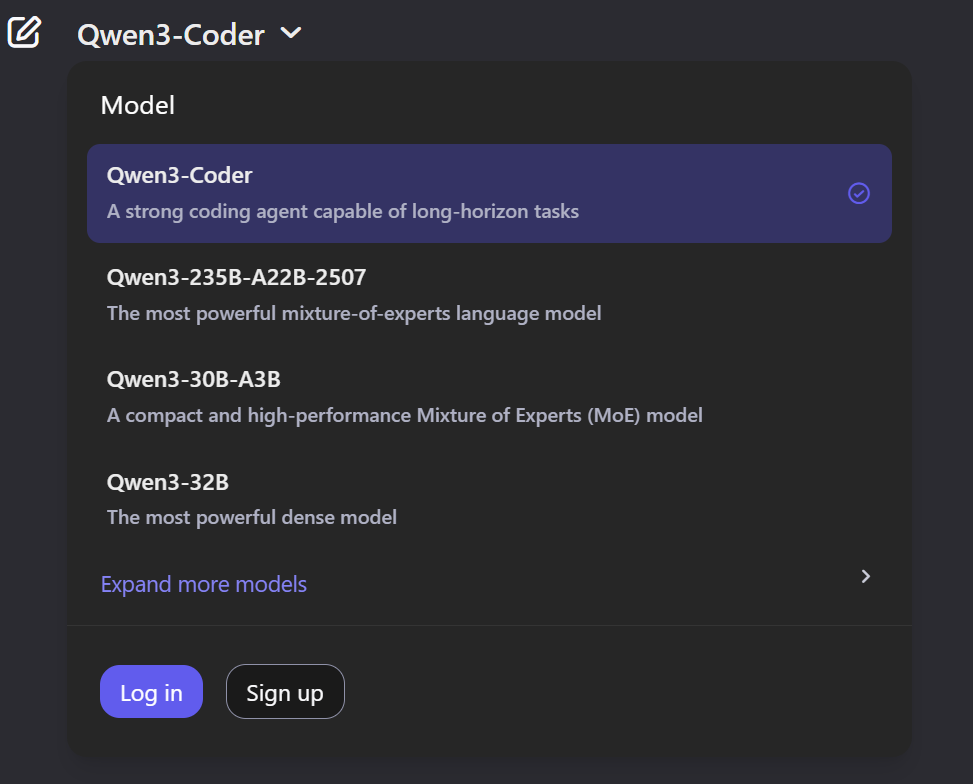

目前,Qwen3-Coder 网页版已经上线,笔者第一时间尝试了它的编程水平。

https://chat.qwen.ai/)

在只提供一句“克隆推特网页设计和UI”提示的情况下,Qwen3-Coder 给出的结果还是不错的:

| Qwen3-Coder 生成的仿推特 UI(来源:资料图)

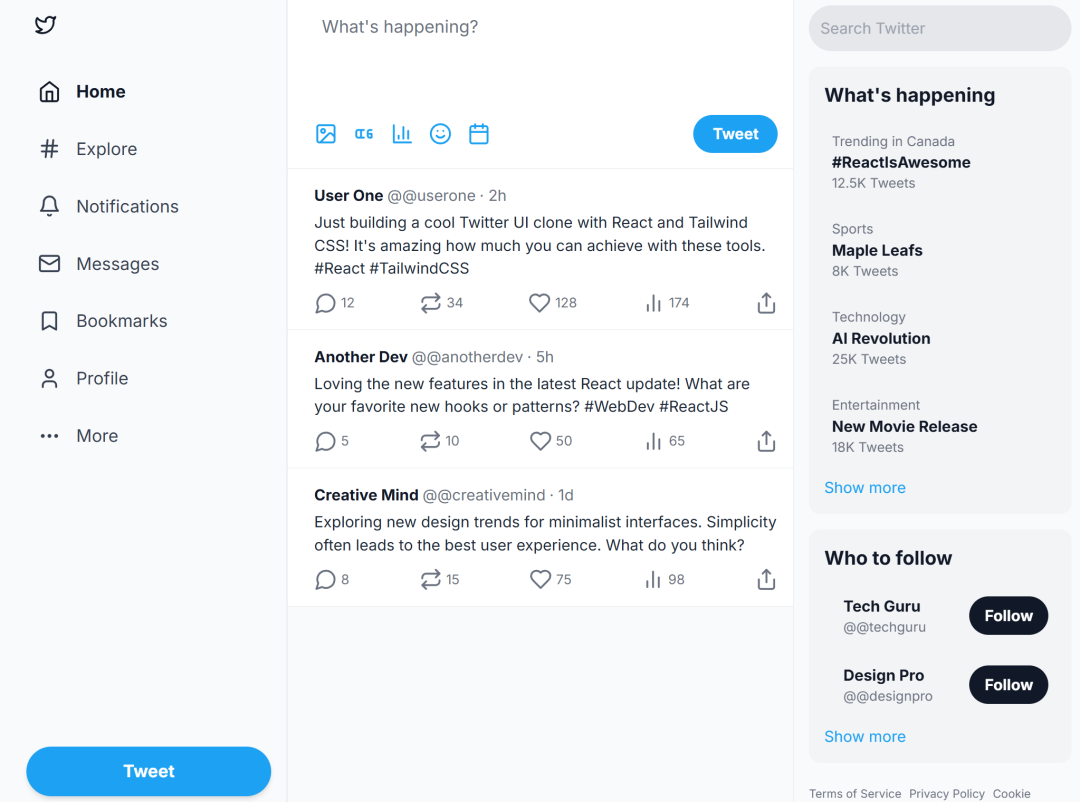

相比之下,ChatGPT(免费版)给出的结果则是有些简陋,虽然文本和几个功能区域都有,但几乎没有视觉元素:

| ChatGPT 生成的仿推特 UI(来源:资料图)

笔者还让 Qwen3-Coder 做了一个简单的网页版乒乓球游戏,同样只是一句话提示:“开发一个可以在网站上运行的乒乓球游戏”。

代码生成后直接在 Artifact 上无缝运行,整个过程不到 20 秒,效果很惊艳,直接用键盘就能控制,支持两人对战,它还自主发挥加上了获胜规则:

(视频:乒乓球)

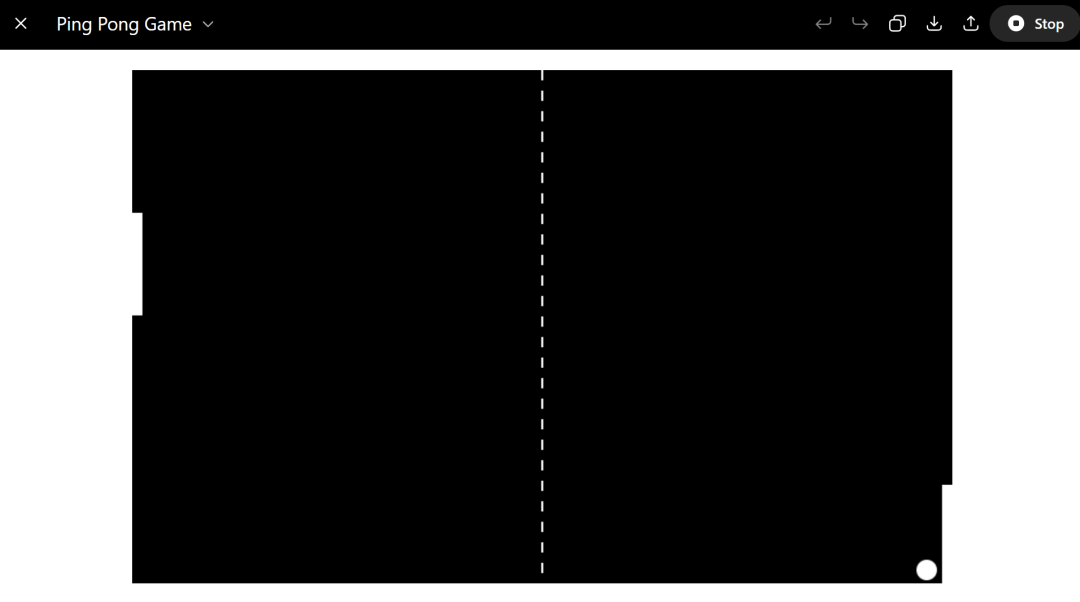

而 ChatGPT 生成的虽然也能运行,但无论是美观还是完整性,都远不及 Qwen3-Coder:

| ChatGPT 生成的乒乓球游戏截图(来源:资料图)

最后是官方给出的两段代码运行效果,分别是地球 3D 模拟和 Flappy Bird 游戏:

(视频:地球3D 模拟)

(视频:Flappy Bird 游戏)

此次发布的 Qwen3-Coder 属于阿里 Qwen3 系列。

三个月前,阿里发布了千问 3(Qwen3)系列模型,包括两款混合专家 MoE 模型、六款密集模型和若干模型变种,例如后训练、FP8 版本等等。

其中的旗舰模型 Qwen3-235B-A22B,总参数量高达 2,350 亿(235B),其中激活参数为 220 亿(A22B),分布在 94 个深层网络层中。

另外一个 MoE 模型 Qwen3-30B-A3B,尺寸较小,总参数量 300 亿,激活参数量 30 亿。

| 3 个月前发布的 Qwen3,到现在已经多次迭代(来源:Qwen3)

当时,Qwen3 系列引入了一种混合方法来解决问题,一个模型同时支持思考模式和非思考模式。但现在这种模式已经被取消。

就在 Qwen3-Coder 发布的前一天,阿里同样更新了 Qwen3 系列,新模型名为 Qwen3-235B-A22B-Instruct-2507(简称 Qwen3-2507),迭代速度令人惊喜。

阿里在官网表示,“经过与社区沟通和深思熟虑后,我们决定停止使用混合思维模式。取而代之的是,我们将分别训练 Instruct 和 Thinking 模型,以获得最佳质量。所以我们发布了 Qwen3-235B-A22B-Instruct-2507 及其 FP8 版本,供大家使用。”

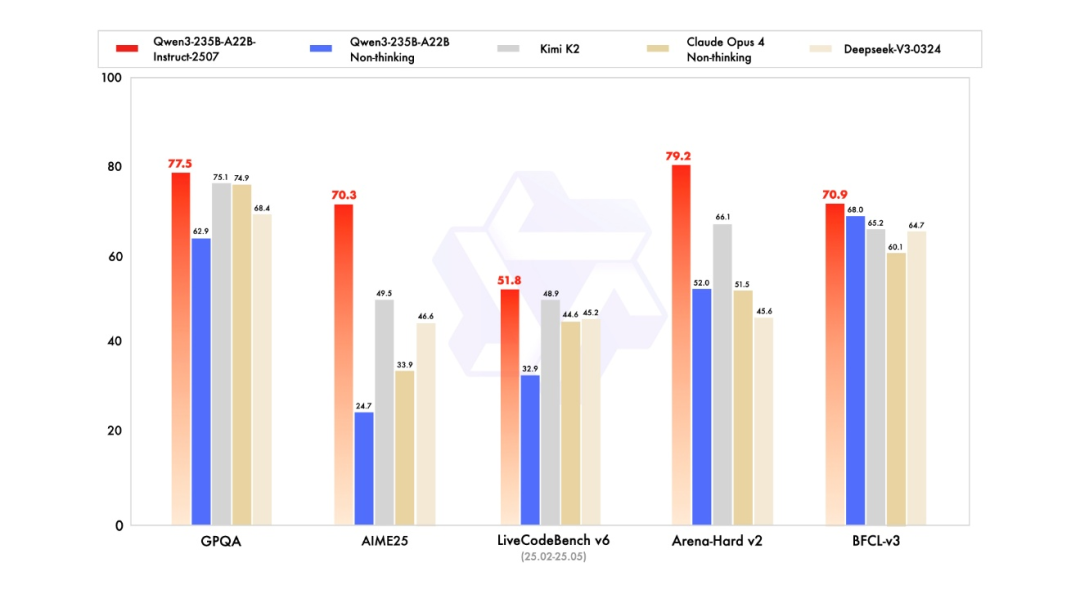

| Qwen3-2507 与其他模型在多项基准测试成绩上的对比(来源:资料图)

Qwen3-2507 在主流基准测试中表现优异。作为一款“没有思考能力”的开源模型,它在 GPQA、AIME25 和 LiveCodeBench v6 等测试中均超越了未开启思考模式的 Claude Opus 4。

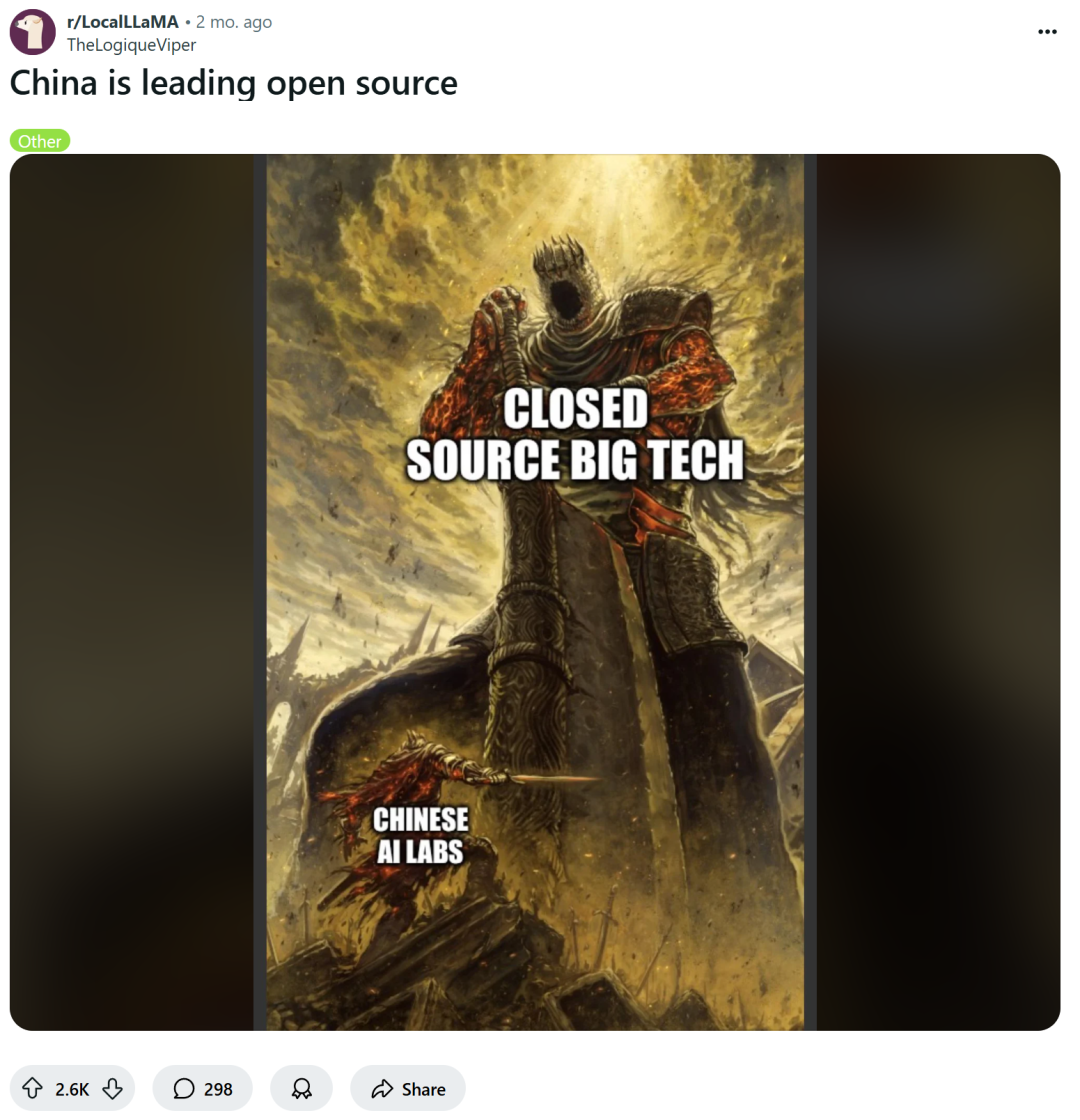

可以说,无论是Qwen3-Coder 还是 Qwen3-2507,再加上 DeepSeek 和 Kimi,都是 AI 开源社区宝贵的财富。

在闭源模型各种刷榜的今天,它们难得的推动了大模型技术的普及化,为AI 社区开发者和研究人员提供了强大的免费工具。更重要的是,它们的广受欢迎让中国在全球 AI 开源领域占据了重要一席。

| Reddit 网友热议:目前全球最好的开源模型都来自中国(来源:资料图)

这不仅能促进 AI 技术的普惠发展,还能有效降低创新门槛,让更多开发者参与进来,共同构建一个更加开放和繁荣的 AI 生态系统。

反过来,这些模型未来在产业应用、学术研究和人才培养等方面都将发挥不可估量的作用,进一步加速中国在 AI 领域的进步。

参考资料:

https://qwenlm.github.io/blog/qwen3-coder/

https://qwenlm.github.io/blog/qwen3/

https://huggingface.co/Qwen/Qwen3-Coder-480B-A35B-Instruct

https://arxiv.org/pdf/2505.09388

“掌”握科技鲜闻 (微信搜索techsina或扫描左侧二维码关注)