包括 6 篇杰出论文奖和 2 篇杰出立场论文奖。

本周一,ICML 2025 公布了最佳论文奖项。

今年获奖论文共计 8 篇,其中包括 6 篇杰出论文奖和 2 篇杰出立场论文奖。值得关注的是,南京大学研究者也位列获奖名单之中。

国际机器学习会议 ICML(International Conference on Machine Learning),是全球范围内人工智能领域的顶级学术会议之一,由国际机器学习学会(IMLS)举办,与 NeurIPS、ICLR 并列为 AI 三大顶会。本届 ICML 为第四十二届,于 7 月 13-19 日在加拿大温哥华举行。

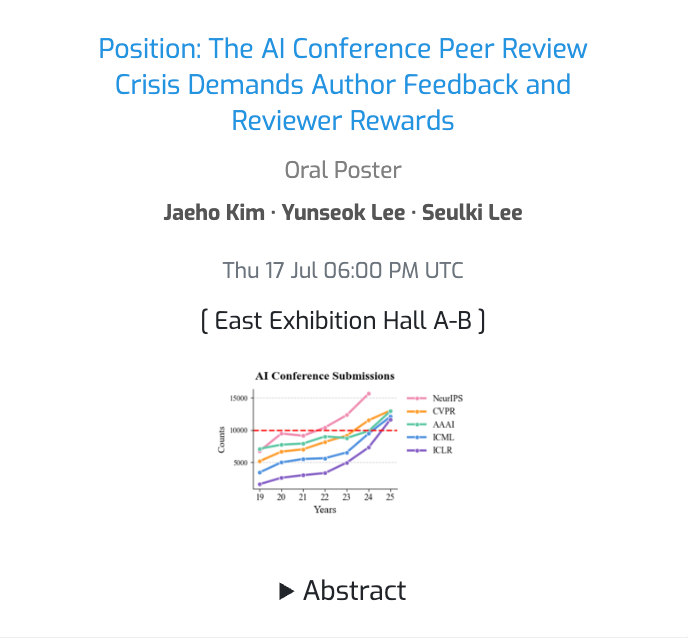

今年的 ICML 大会共获得 12107 篇有效论文投稿,其中 3260 篇被接收,接收比例为 26.9%。相比 2024 年的 9653 篇投稿数量持续大幅增长,展示了 AI 领域的火热。

以下是今年的获奖论文与简要介绍。

杰出论文奖

论文 1: Train for the Worst, Plan for the Best: Understanding Token Ordering in Masked Diffusions

论文地址:https://arxiv.org/pdf/2502.06768

作者:Jaeyeon Kim、Kulin Shah、Vasilis Kontonis、Sham Kakade、Sitan Chen

机构:哈佛大学、得克萨斯大学奥斯汀分校

论文摘要: 近年来,掩码扩散模型(MDMs,masked diffusion models)逐渐崭露头角。与自回归模型(ARMs)相比,MDMs 在训练时通过牺牲复杂性来换取推理时的灵活性。具体而言,在训练阶段,MDM 学习解决大量的填充问题,但在推理时,它们几乎以任意的顺序解码 Token。

本文深入研究了这两种竞争效应。

在训练层面,本文通过理论分析和实验验证表明:相较于自回归模型,MDMs 确实需要处理计算复杂度更高的子问题。在推断层面,本文发现采用自适应 Token 解码顺序的策略能显著提升 MDMs 的性能,使其有效规避困难子问题。

在像数独这样的逻辑谜题中,自适应推理可以将预训练 MDMs 的解题准确率从不到 7% 提高到约 90%,甚至超越了具有 7 倍参数量的自回归模型,这些模型通过教师强制(teacher forcing)显式训练,学习正确的解码顺序。

论文 2:The Value of Prediction in Identifying the Worst-Off

论文地址:https://arxiv.org/pdf/2501.19334

作者:Unai Fischer Abaigar、Christoph Kern、Juan Perdomo

机构:慕尼黑大学、哈佛大学

论文摘要:机器学习正越来越多地用于政府项目中,以识别和支持最弱势群体,优先为他们提供援助。

本文研究了在追求公平的背景下,预测技术对福利分配的影响,并将其与其他政策工具(如扩大行政资源)进行比较。

通过数学模型和针对德国居民长期失业问题的真实案例研究,本文系统性地评估了预测技术在识别最弱势群体方面的有效性。研究成果为政策制定者提供了明确的分析框架和实用的数据驱动工具,帮助他们在设计此类系统时做出有原则性的决策。

论文 3:CollabLLM: From Passive Responders to Active Collaborators

论文地址:https://arxiv.org/pdf/2502.00640

论文主页:https://wuyxin.github.io/collabllm/

作者:Shirley Wu、Michel Galley、Baolin Peng、Hao Cheng、Gavin Li、Yao Dou、Weixin Cai、James Zou、Jure Leskovec、Jianfeng Gao

机构:斯坦福大学、微软、佐治亚理工学院

论文摘要:大语言模型通常使用下一轮奖励进行训练,这限制了它们在长期互动中的优化能力。因此,它们常常对模糊或开放性用户请求作出被动回应,未能帮助用户实现最终意图,导致对话效率低下。

为了解决这些局限性,作者提出了 CollabLLM,这是一种新颖且通用的训练框架,旨在增强多轮人类与大语言模型的协作。

其关键创新在于通过多轮感知奖励的协作模拟,估算响应的长期贡献。通过强化学习对这些奖励进行微调,CollabLLM 不仅仅回应用户请求,还能主动挖掘用户意图,并提供富有洞察力的建议,这是迈向更加以人为本的人工智能的关键一步。

他们还设计了一个多轮互动基准,涵盖了如文档创作等三项具有挑战性的任务。与基线模型相比,CollabLLM 在任务表现上提高了 18.5%,并且在语言模型评审者的互动性上提高了 46.3%。

最后,他们进行了一项大型用户研究,涉及 201 位评审者,其中 CollabLLM 提高了 17.6% 的用户满意度,并减少了 10.4% 的用户花费时间。

论文 4:Roll the dice & look before you leap: Going beyond the creative limits of next-token prediction

论文地址:https://arxiv.org/pdf/2504.15266

作者:Vaishnavh Nagarajan, Chen Henry Wu, Charles Ding, Aditi Raghunathan

机构:Google Research、卡内基梅隆大学

论文摘要:作者设计了一套最小化的算法任务,作为开放式现实任务的一个宽泛抽象。这使他们能够干净且可控地量化当今语言模型的创造性极限。

与需要创造性、远见性思维飞跃的现实任务类似,他们的任务需要一个隐式的、开放式的随机规划步骤,该步骤要么(a)发现抽象知识图中的新联系(如文字游戏、类比或研究),要么(b)构建新模式(如设计数学问题或新蛋白质)。

在这些任务中,作者在经验和概念上论证了为什么下一个 Token 学习是目光短浅的;多 Token 方法,即无教师训练和扩散模型,相比之下在生成多样且原创的输出方面表现更为出色。

其次,为了在不损害一致性的前提下引发随机性,他们发现将噪声注入输入层(称为种子条件化)在很多条件下的效果与(并且在某些条件下优于)从输出层进行温度采样的效果一样好。

因此,他们的工作为分析开放式创造性技能提供了一个有原则的、最小化的测试平台,并提出了超越下一 Token 学习和温度采样的新论据。

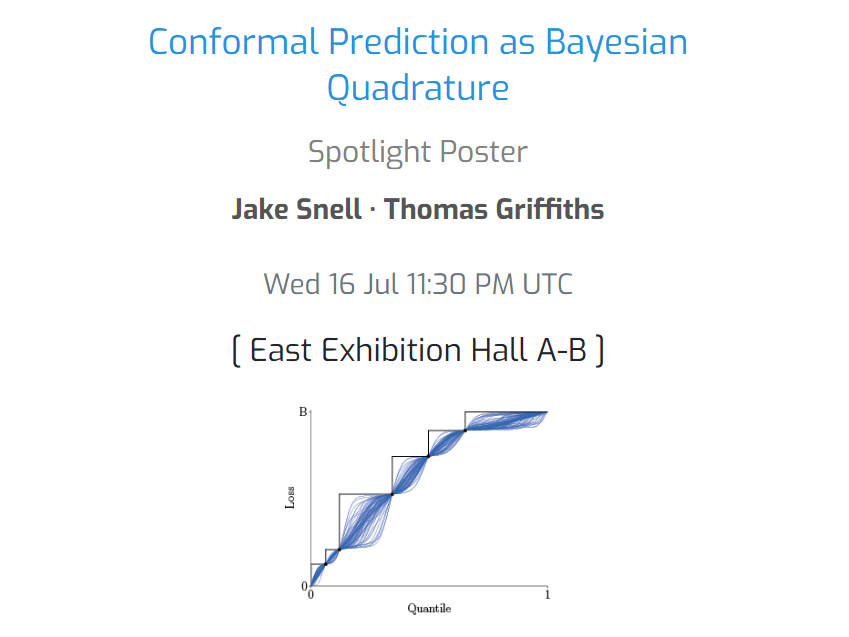

论文 5:Conformal Prediction as Bayesian Quadrature

论文地址:https://arxiv.org/abs/2502.13228

作者:Jake C. Snell、Thomas L. Griffiths

机构:普林斯顿大学

论文摘要: 基于机器学习的预测系统在高风险场景中的应用日益广泛,了解此类预测模型部署后的表现至关重要。诸如共形预测之类的分布无关不确定性量化技术,即使在模型细节隐藏的情况下,也能保证黑盒模型的损失。然而,此类方法基于频率概率,这过度限制了它们的适用性。本文从贝叶斯视角重新审视共形预测的核心内容,从而阐明频率概率保证的不足之处。

本文提出了一种基于贝叶斯求积的实用替代方案,它能够提供可解释的保证,并更全面地表示测试时可能观察到的损失范围。

论文 6:Score Matching with Missing Data

论文地址:https://arxiv.org/abs/2506.00557

作者:Josh Givens、Song Liu、Henry W J Reeve

机构:布里斯托大学、南京大学

论文摘要:分数匹配是学习数据分布的重要工具,其应用领域涵盖扩散过程、基于能量的建模和图模型估计等诸多领域。尽管应用广泛,但很少有研究探讨其在数据不完整情况下的运用。

该研究通过调整分数匹配(及其主要扩展)来解决这个问题,使其能够在灵活的设置下处理缺失数据,其中数据可能在任何坐标子集上出现部分缺失。本文提供了两种独立的分数匹配变体供一般使用:重要性加权 (IW) 方法和变分方法。本文在有限域设置下为 IW 方法提供了有限样本边界,并证明其在小样本低维情况下尤其表现出色。

此外,本文还证明了变分方法在更复杂的高维设置下表现最佳,这一点在真实数据和模拟数据的图模型估计任务中均得到了验证。

杰出立场论文奖(Outstanding Position Paper)

ICML 大会在 2024 年首次设置了 Position Paper 赛道,与传统 research paper 不同,它更注重观点性、前瞻性和讨论性,而非纯粹的技术创新。该赛道鼓励作者提出对机器学习领域关键问题的深刻见解、争议性观点或未来发展方向的分析,旨在激发学术界的广泛讨论和反思。

今年有 2 篇论文入选。

论文 1:The AI Conference Peer Review Crisis Demands Author Feedback and Reviewer Rewards

论文地址:https://arxiv.org/abs/2505.04966

作者:Jaeho Kim、Yunseok Lee、Seulki Lee

“掌”握科技鲜闻 (微信搜索techsina或扫描左侧二维码关注)