通往AGI终极之路,是什么?

这世界,没有一个完整的定义,也没有具体的答案。

此前曝出的OpenAI秘密路线图,将通往AGI目标划分五级。

而「草莓」o1模型出世,代表着第二级已经实现。

李飞飞估值10亿美金独角兽World Labs,将「空间智能」看作通向AGI重要的桥梁。

他们计划打造出「大世界模型」(LWM),通过对世界建模,让AI在3D世界中去感知、去生成、去互动。

国内一家AI初创团队,对此也有不同的看法。

他们认为,「群体智能」是迈向更广泛的通用人工智能的路线。未来,世界每个设备都拥有自己的智能,能够以类人的方式交互。

不过,实现这一想法的前提是,我们需要一个创新的算法架构。

值得一提的是,这个团队却做了一件「反直觉」的事——首创非Transformer独特路线。

基于全新架构,他们打造的Yan系列模型已经植入到树莓派、机器人、AIPC等终端设备中。

恰在RockAI开放日上,多模态模型Yan1.3全面升级,直接击败开源Llama 3,「真端侧」最强大脑诞生了!

模型端到端,秒级实时人机交互

全新迭代后的Yan1.3,支持从文本、音频、视觉输入,并以语音、文本方式输出。

它模拟了人类复杂的感知系统,既能听懂自然语言、看懂视觉信息,也能通过语音方式表达。

可以说,它是全球首个人机交互领域中,端到端的多模态大模型。

凭借出色的架构设计,Yan1.3模型在兼容性和性能,取得了最优的表现,从低算力到高算力全面覆盖。

在不同终端上的体验,多模态Yan1.3更是实现了秒级实时响应。

在CPU上秒级响应,GPU上更是有百毫秒级的人机交互,体验非常丝滑赶超云端的大模型。

不如一起来看看,Yan1.3在手机、PC、机器人、无人机上,如何无损部署的。

低配1500元可跑,真·AI手机来了

在人手一台手机的时代,搭载一个本地的大模型,那才是真·AI手机。

现场演示中,离线部署Yan1.3 3B参数的手机,直接断网,上演了不用联网也能体验LLM的精彩一幕。

告诉语音助手RockAI自己的需求——介绍一下上海。它在遵循指令后,瞬间给出了关于上海的一些简单概要。

它还可以跨应用,完成系统的调用。

让它打开相册,并找出一张夕阳的照片。

RockAI不仅准确找到了夕阳照片,还给出了小红书的风格描述,这种费脑的事儿,它全部代劳了。

更惊艳的是,告诉它今天是小明生日,并帮自己为其送上祝福。

RockAI直接进入短信界面,自动生成编辑了一段内容,你所做的就是点击「发送」了。

可见,一个30亿参数离线模型,同时具备了以文找图、以图生文,Agent、语音助手等能力,强大到足以让人震撼。

在同等的手机硬件配置上,Yan1.3模型相比Transfomer有30%的性能超越。

或许有的人会问,能够运行这样的模型,一定需要高配的手机。

RockAI联创邹佳思称,从低端¥1500到中端¥3000配置,而且还只是8G运行内存,都可以无损适配。

懂人话高效助手,AI PC更便利

不仅如此,在个人PC上,业界早就掀起了AI PC的概念。

但若是没有在设备端完全部署模型,AI能力的使用会严重受限。而且,AI PC根本无法普及到大多数用户。

接下来,这段现场演示中,直接为AI PC掐断了网线。

上传一段主持人的天气预报音频,然后AI智能助手将其实时转录成了文字。

转写完成后,还能帮你立即总结出一份摘要。

另外,每个人办公时均会遇到一个困扰,「xxx图片」谁知道保存到了哪个文件夹。

现在,这个烦恼完全可以打消了。

只要一句话,AI智能助手就能直接帮你找到想要的那个图片。

而且,它还可以支持以图搜图的方式。

这些功能的实现,仅需要一台配备英特尔Core i5主机即可流畅运行。

四步成诗,轻松拿捏新中式

Yan1.3还在人形机器人上,实现了离线运行。

我们都知道,构成机器人最核心的三要素,便是大脑、小脑、本体。

如果让一个冰冷的机械,同时具备「看听说想动」的能力,并基于已有的知识完成决策,最后指挥肢体进行行动。

这样的前提,一定是离不开大模型、分层控制算法的植入。

当你呼叫小苏小苏,你看见了什么?

凭借强大的多模态认知能力,它准确地描述出了当前周围的环境和布局。

另外,Yan1.3「大脑」控制的躯体,还能完成各类高效复杂的任务。

现场,让小苏吟诗一首——关于冬天的七言绝句,并在4步之内完成。

只见小苏一边走,一边完成了绝美的创作。

寒风凌冽雪纷飞,万物萧疏鸟自栖。唯有梅花凌雪放,清香四溢满庭芳。

有趣的是,当小苏吟诗后离拍摄者太近,让它让一让。

只见,憨态可掬的它向另一边慢慢踱步。

其实,在今年世界人工智能大会上,搭载Yan模型,基于树莓派打造的胖虎机器人就亮相了。

它在现场七步成诗、咏春拳法等各种精彩演示,吸引了一大波围观歪果仁观看。

城市巡检拍照,无人机全包了

而在无人机方面,搭载Yan1.3后的用法就更多了。

它不仅可以治安巡逻、交通巡检,异常监控,还可以当那个为你抓拍美照的「男友」。

当然了,智能巡检这类任务,对于一个城市管理来说非常重要。

植入离线模型的无人机,可以从多方位感知环境,快速识别图像信息,自适应调整飞行高度。

它可以搭配手机,完成「端」和「端」的互联操作。

交通巡检过程中,它可以智能识别违规车辆,并将信息传送到手机上。

当你自拍找不到满意角度,直呼「飞龙,给我拍一张氛围感满满的照片」。它一跃升天,拍下了多种角度的照片,通过对照片的多维度评分,还贴心地帮你选好了最美瞬间。

可见,全新升级的Yan1.3已经赋予了每个端侧设备「灵魂」。

它不仅在无人机、机器人、PC、手机等终端设备中,丝滑适配,而且模型智能能力迎来了全新升级。

无需阉割模型,让端侧设备具备了完整性、可持续性。

这种类人的输入输出过程,不仅大幅地提升人机交互的质量,还为未来教育、医疗等行业开辟了更广阔的应用场景。

当一个最强端侧完成进化,那么一群最强端侧协作,能够实现什么?

简言之,群体智能。

群体智能,怎么实现?

其实,群体智能,很早就存在于生物界。

蚁群会一起搬运食物、搭建蚁巢;蜜蜂会各司其职,协作维护蜂巢;狼群结队,捕获猎物等等。

这些都是,生物界群体智能的体现。

纵观生物界的发展,能够得出一个基本规律——个体智能化程度越高,群体智能的表现力越强。

就像人类一样,我们的群体智能,所表达出的文明程度远远高于蚁群、蜂群、狼群.......

从中汲取灵感,人工智能也会有「群体智能」。

单元大模型的智慧,能够反哺整个大模型群体,进而让AI群体更聪明、更智能。

或许你会说,其实国外很多研究,早就通过多个智能体协作,实现了高性能群体智能。

其实不然,它们之间有着本质的区别。

智能体本身,存在一个很大缺陷——不具备自主学习能力。

而且,智能体之间的协作,也是一个很小范围的协作。

究其根本,是因为基于Transformer架构大模型搭建的智能体,实现自我训练非常困难。

群体智能中最核心的要素便是个体,也就是「端」。

而基于Transformer架构的模型,若想在端上运行、并自主学习,根本不可行。

因为模型通常会被量化裁剪压缩之后,才会植入端设备。而被阉割之后的模型,就不再具备学习能力。

那该如何破解?

为了实现群体智能,RockAI经过多年的技术沉淀,独创了不同于Transformer的MCSD架构,并且提出了「类脑激活」机制。

这条路线,与OpenAI、World Labs有着本质区别,是国产公司在AGI前沿另辟蹊径的尝试。

Transformer不是唯一路径

当前的现状是,大模型领域早已呈现出Transformer「一家独大」的格局。

用AI大神Karpathy的话说:最先进的GenAI模型,要么是自回归训练,要么是扩散训练,底层的神经网络通常都是Transformer架构。

虽然Transformer自身有许多优秀的特质,但不可否认,这仍不是一个百分百完美的架构。

甚至,有很多业界AI大佬已经看到了其中的巨大弊端。

首当其冲的,就是被诟病已久的幻觉问题。

Yann LeCun认为,LLM的幻觉根源于当前所使用的自回归Transformer架构。

「幻觉问题是自回归LLM架构特有的」「自回归LLM会产生幻觉…幻觉是自回归生成的本质缺陷」

这种架构上的本质缺陷,注定了有一天我们要走出Transformer生态,就像曾经90年代末走出SVM生态、3年前走出BERT生态一样。

就连提出Transformer核心架构作者之一Aidan Gomez认为,这世间需要比Transformer更好的东西,希望将其取代,把我们带向更高的性能高地。

「现在使用了太多计算资源,做了很多浪费的计算」

部署方面,基于Transformer架构模型对终端设备运行内存、储存空间提出了更高要求,同时压缩后的模型,在实际推理上大打折扣。

能源方面,今年3月,马斯克表示,2025年AI将耗尽电力和变压器,用他的话来说,「很讽刺的是,我们需要transformers(变压器)来运行transformers(模型)。」

很明显,无论是从减少幻觉、推动技术进步的角度,还是从环境保护、促进GenAI发展可持续的角度,我们都急需一种能够跳出Transformer「思维圈」的新架构诞生。

国内首个非Attention机制

RockAI首次提出的MCSD(Multi-Channel Slope and Decay)架构就是跳出Transformer路线的一次绝佳尝试。

而MCSD最大的特点,便是替换了Transformer架构中的注意力机制。

随着序列长度的增加,Transformer架构对计算资源的消耗呈现O(N^2)增长,相比之下,MCSD实现了线性扩展,而且推理速度更快,将空间和时间复杂度分别降低到了O(1)和O(N)。

直白讲,MCSD全新架构能够将算力消耗降至更低。

也就意味着,基于此架构打造的模型,在端侧设备上运行有了新的可能。

论文地址:https://arxiv.org/abs/2406.12230

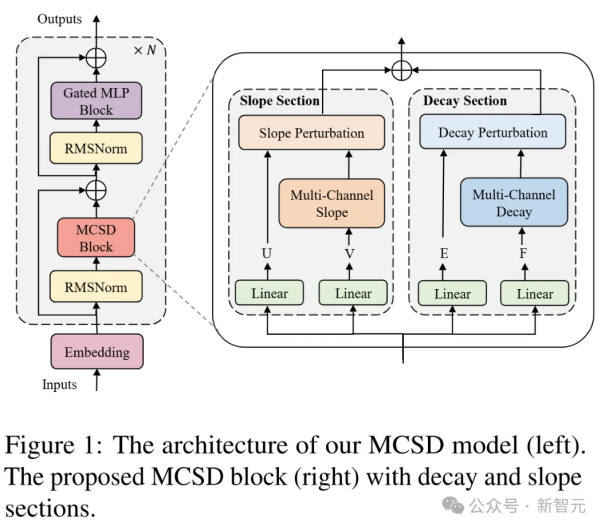

MCSD的具体架构如图1所示,由嵌入层和N个相同的组合层堆叠而成,每个组合层中由两个残差连接分别封装MCSD块和门控MLP块,两者都前置一个RMS归一化模块,并使用GeLU作为激活函数。

MCSD块的内部结构如图1(右)所示,集成了slope部分和decay部分,分别通过不同的预定义矩阵捕捉局部和全局特征。

两个部分均采用了双分支设计,一个分支负责进行线性投影,另一个通过聚合前面token的上下文信息来提取多通道历史特征,之后两个分支进行扰动(perturbation)操作。

slope和decay部分主要存在两方面的区别,一是预定义权重不同,因此在提取历史信息时对上下文的感知能力不同,前者更注重短程上下文,后者则更关注全局上下文。

将slope和decay两部分的输出进行拼接后就得到了MCSD块的输出,这两者的组合使得模型既能关注到距离更近的历史信息,也不会丢失更远的长距离上下文,从而同时增强了局部和全局的特征提取。

此外,论文还提出通过递归形式简化推理计算,将推理所用的空间和时间复杂度分别降低至O(1)和O(N),显著压缩了所需算力。

实验数据显示,随着序列逐步变长,KV缓存的存在让Transformer推理的内存成本呈线性增加;相比之下,即使是8k的长序列,MCSD消耗的GPU内存也几乎不变。

给定序列长度后,随着批大小的增加,Transformer的延迟也会显著增加,而MCSD的延迟则依旧十分稳定。

此外,有相同批大小或序列长度时,MCSD的吞吐量性能也远远好于Transformer架构。

除了大大节约吞吐量、延迟、内存消耗等方面的成本,MCSD还在基准测试上有更佳的性能。

类脑激活机制

基于MCSD架构,RockAI实现了能在「端侧」运行群体智能单元大模型。

但这并不代表着,能够在更多端侧上实现最优性能。

因此,RockAI还在Yan系列模型中采用了独创的「类脑激活」机制,实现基于仿生神经元驱动的选择算法。

在主流的神经网络中,每次推理都需要激活全部神经元,这会导致大量算力浪费。

而人脑的运作并非如此。

不同的大脑区域负责不同的认知功能,因此不同的执行不同的任务只会造成一部分脑神经元的激活,而且激活的区域也各有不同。

比如开车时,视觉皮层会更加活跃;而写作时,掌管记忆或逻辑的脑区激活程度更高。这也许就是为什么,相比调动每个处理单元的计算机,大脑明显更加「节能」。

因此,模拟大脑中的神经元激活模式,可以让神经网络更加高效地处理复杂数据和任务,从而显著提升计算效率和精度。

通过以上两种方式结合,一是用MCSD替换注意力机制,而是通过选择性神经元计算,带了极致低算力消耗。

正是基于如此强大的「双机制」,RockAI在今年1月发布了国内首个非Transformer架构的大模型Yan 1.0。

随之7月,发布了国内首个终端多模态大模型Yan 1.2。

经过几次迭代,目前已经升级为端到端的多模态Yan 1.3,代表着迈向群体智能的新起点,是群体智能的单元大模型。

厚积薄发,终极目标迈向群体智能

要实现AI的群体智能,并不是一件简单的事,提出MCSD架构和「类脑激活」机制,只是一个开始。

为了达到群体智能,RockAI将这个大目标分解为4个阶段的子目标,一步步稳扎稳打。

目前,他们已经跨越了第一级,正在完成第二级的跃升。

创新基础架构,是要跳出Transformer的既定路线,旨在实现模型性能效率的跨越式发展;

多元化硬件生态,则是模型部署落地的根本保证,只有适配多终端、多厂商、多型号的硬件,形成成熟的生态,才能为群体智能创造实现条件。

随着Yan 1.3模型的发布和广泛部署适配,意味着前两个阶段的目标已经基本实现。

从Yan 1.0到Yan 1.3,不仅覆盖了更多设备,还实现了端到端的多模态支持。

输入输出形式包含了文本、语音、视觉在内的多模态,不但大大方便人机交互,还能让多个AI模型之间更灵活地交流同步。

下一步,RockAI将继续发布Yan2.0,继续强化模型的自主学习、自我优化能力,让AI更好地和真实的物理世界交互。

在Yan系列智慧生态的基础上,持续的群体进化将成为可能,最终绘制出「群体智能」的未来蓝图。

申请创业报道,分享创业好点子。点击此处,共同探讨创业新机遇!

“掌”握科技鲜闻 (微信搜索techsina或扫描左侧二维码关注)