不要神化ChatGPT

文|周文斌

“ChatGPT的意义不亚于PC或互联网的诞生”,比尔盖茨对这个新风口不吝赞誉。

裁员潮下一片惨淡的硅谷,因为ChatGPT再次燃起了希望之光。

微软斥资100亿美元投资OpenAI,并计划将ChatGPT融入旗下全线产品。2月4日,微软融合ChatGPT-4的Bing已经短暂上线,速度之快让人咂舌。

图:融入ChatGPT的Bing

而为了应对微软激进的布局,谷歌紧急地召回了佩奇和布林两位创始人,并在上周也开始内测类似的产品Apprentice Bard。同时,谷歌还向OpenAI的竞争对手Anthropic投资近4亿美元,以完成微软和OpenAI类似的绑定。

中国科技公司也在纷纷跟进,一波类似于2016年AlphaGo的热潮又一次掀起。

2月7日,百度公布了自家类ChatGPT产品的名字“文心一言”,并预计在3月推出相应的产品。

2月8日,阿里巴巴也透露,聊天机器人ChatGPT目前处于内测阶段。

同日,网易有道CEO周枫也独家向光锥智能确认,网易有道未来或将推出ChatGPT同源技术产品,应用场景围绕在线教育。

2月9日,腾讯也表态正有序推进ChatGPT和AIGC相关方向的专项研究。

一时间,不仅科技圈无人不谈ChatGPT,甚至有不少人也开始用其面向普通用户赚钱。瑞银预测,ChatGPT的月活跃用户在今年1月份达到了1亿,它完成这个目标只用了2个月,而在它之前,最快的TikTok大概花了9个月,这让ChatGPT成为迄今为止增长最快的消费者应用。

在此之前,AI产品更多是针对B端的产品,ChatGPT也打破了to B到to C的圈层壁垒。

当然,ChatGPT的伟大,更重要的还是它让通用型人工智能进一步成为可能,并降低了这项技术的进入门槛,让更多开发者能够以低成本的方式在ChatGPT的基础上开发专属应用,让AI改造世界的可能性进一步提升。

可以说,就像25年前刚刚萌芽的互联网正准备对全球带来翻天覆地的变革一样,如今ChatGPT的出现,让AI成为新一轮技术爆发的奇点成为可能。

但是,光锥智能在和中国人工智能行业从业者交流后,发现不少技术从业者反而不如圈外如此狂热。这是因为,渐进式技术进步到今天,并非一蹴而就,技术从业者一直都在保持着密切的观察和技术跟进。

ChatGPT很牛,但不要神化它。

硅谷只剩AI了

谈起ChatGPT,我们仍然要从硅谷开始。和互联网、Web3、元宇宙等之前大多数具有革命或非革命意义的技术突破一样,ChatGPT仍然来自于硅谷。

但和之前硅谷各项技术方向百家争鸣不同,这个时间点的ChatGPT更像是硅谷没有选择的选择。

2022年,硅谷就经历了一波大裁员,并波及了几乎所有的科技公司。到了2023年2月,虽然冬天的气温已经有所回升,但硅谷的寒意却还没有褪去。

据trueup.io统计数据,在2023年刚刚过去的这一个月,全球326家科技公司累计裁掉了106950万人,其中大头都在硅谷,而且打击面还非常广泛,元宇宙、芯片、自动驾驶和SaaS都是重灾区。

一直以来,裁员都是一个行业不景气的直接表现。

以Wbe3为例,Coinbase在2023年1月计划裁掉公司20%的员工,这是美国第一家上市的合规加密交易平台,且这家公司已经在去年6月裁掉了18%的员工。

研究公司PitchBook的数据显示,在2022年第四季度,Wbe3行业的风险投资就已跌到了这两年以来的最低水平,比2021年同期下降了75%。

在芯片领域,美光、格罗方德、英特尔等巨头无一幸免,其中泛林集团裁员1300人,因特尔下调包括CEO在内的管理人员薪酬,并裁员数百人。SaaS领域,Salesforce在1月4日宣布裁员8000人,约占全体员工的10%。自动驾驶方面,包括Waymo、Crusie、图森未来、无人车配送公司Nuro都有裁员的消息传出。

除此之外,曾经被倾注下一代互联网希望的元宇宙也终于走到了拐点。

去年11月,Meta确认了成立18年来首次大规模裁员,扎克伯格向被裁员工道歉,“我错了,我要为此次裁员,以及我们是如何走到今天这个地步负责。”

投资人也不再看好Meta的元宇宙未来,美国投资公司Altimeter Capital向Meta发表公开信,呼吁公司削减20%的员工成本,并将‘元宇宙’项目的支出限制在每年50亿美元。

而相比于一头扎入元宇宙之后又船大难掉头的Meta,涉足稍浅的微软则果断选择了弃旧从新。

首先,微软对元宇宙相关业务进行了大刀阔斧的裁剪,其宣布将在3月10日关闭2017年收购的社交平台AltspaceVR,并有可能摆脱混合现实工具包(MRTK)团队。

同时,微软又在AI方面大力投入。1月初,微软就计划向OpenAI投资100亿美元,然后宣布要将包括Bing搜索、Office、Azure在内的旗下全线产品整合ChatGPT。到2月7日,微软已经在Redmond召开了整合ChatGPT的Bing发布会。

其实从ChatGPT面世第一天开始,ChatGPT颠覆传统搜索的观点就已经不胫而走。所以面对微软激进的布局,谷歌2月6日宣布推出一款聊天机器人Bard来与ChatGPT竞争,谷歌云计算部门也在开展一个名为“Atlas”的项目。

2月7日,谷歌向ChatGPT的竞争对手Anthropic投资了约3亿美元,获得了10%的股份,这让谷歌和Anthropic形成了类似微软与OpenAI的绑定关系。

除了谷歌和微软之外,在ChatGPT上线前三个月,Meta其实也曾发布过一款类似的聊天机器人,只是并没有获得太多影响力。用Meta首席人工智能科学家雅恩・勒昆(Yann LeCun)的话说,“Meta的Blenderbot让人觉得很无聊”。

相应的,亚马逊也已经将ChatGPT应用到了包括回答面试问题、编写软件代码和创建培训文档等工作职能中。一名亚马逊员工在Slack上表示,亚马逊云部门已经成立了一个小型工作组,以更好地了解人工智能对其业务的影响。甚至,连苹果都宣布要在下周召开内部AI峰会。

如今的硅谷,AI已经成为了绝对C位。

这种转向其实也表现在投资机构的动态上,2021年12月,红杉资本将自己在Twitter上的简介从“帮助有冒险精神的人创建伟大的公司”改成了“从想法到落地,我们帮助富有冒险精神的人打造伟大的DAO。”2022年,Web3赛道火热,红杉在2022年1月1日-4月26日,以大概每周一家的速度投资了17家Web3公司。

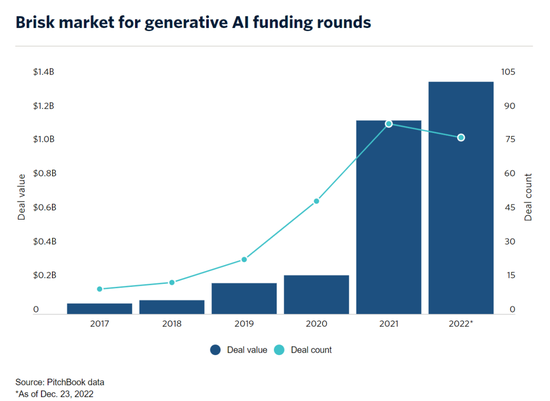

但变化发生在去年9月,红杉资本发布了一篇文章《生成式AI:一个创造性的新世界》。其中写道,生成式AI有可能创造数百万亿美元的经济价值。

PitchBook的一项统计数据显示,2022年投资圈向生成式AI公司共投入13.7亿美元(折合人民币约93.69亿元),几乎达到了过去5年的总和。这些投资中不仅包括OpenAI、Stability AI这样的头部企业,也包如Jasper、Regie.ai、Replika等初创企业。

整体上,从投资人到大企业,再到创业者,一场关于AI 2.0的大幕已经拉开。

中美差距没那么大

从硅谷到中国,ChatGPT的热度有增无减。

毕竟一直以来,关键的技术革新都发生在硅谷,这两年中国尖端技术又一直面临卡脖子的问题。所以在ChatGPT出现之后,大家最关心的还是当国外技术已经开始商业化落地的时候,国内的进度到底如何,差距又有多少?

2月7日,百度对外公布了自家类ChatGPT产品的名称“文心一言”,英文名叫ERNIE BOT,目前,文心一言正在做上线前的冲刺。

“文心一言”一经透露,便迅速登上各大平台热搜,百度股价一度涨超17%,市值增长约700亿港元。很明显,市场对于一个中国版的ChatGPT已经期待太久。

之前,有观点认为国内外差距大概在两年左右。但云知声研发副总裁刘升平认为,实际上的差距可能没有这么远。两年的说法是因为GPT-3是在两年前公布的,但其实自GPT-3发布之后,国内许多企业就已经跟进在做类似的大模型了。“实际差距并没有那么大,大概在一年左右。”

小冰公司CEO李笛也向光锥智能提到:“国内人工智能技术不像芯片、操作系统一样落后于国外,相反它应该是最接近国际的。”

“国内外的差距主要是一种思维上的差距。”李笛认为,国内对技术创新这件事鼓励得不够充分,如果一个公司耐得住寂寞,那它无论在哪个方向都是OK的。

事实上,国内大厂基本都具备训练大模型的能力。比如百度这次发布的文心一言,就和百度文心大模型一脉相承。

百度在发布文心一言名字的时候还特意提到,在人工智能四层构架中有全栈布局,包括底层芯片、深度学习框架,大模型以及最上层的搜索等应用。拥有产业级知识增强文心大模型ERNIE,具备跨模态、跨语言的深度语言语义理解与生成能力。

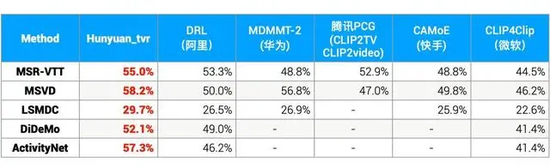

同样的,腾讯也有类似混元AI大模型,在此基础上,腾讯推出了HunYuan-NLP 1T大模型并一度登顶国内最权威的自然语言理解任务榜单CLUE。此外,像阿里有“通义”大模型,华为有盘古大模型,国家队中科院自动化研究所有“紫东·太初”等等。

简单来说,国内大厂基本都有做NLP预训练模型的能力,甚至许多专业能力还处在世界领先的水平。

比如腾讯的混元大模型在2022年11月公布了一项最新进展,它们实现万亿级NLP模型,可以用256张卡,最快1天内完成训练,成本相比原来降低1/8。

作为对比,ChatGPT训练一次的成本高达1千万美元,这是一般企业无法承受的。小冰公司CEO李笛算过一笔账:“如果按照ChatGPT成本来考量的话,每天我要烧3亿人民币,一年要烧一千多亿。”

而腾讯通过课程学习、MOE路由算法、模型结构等方式优化之后,让更多企业能够承担得起训练自己的NLP模型的成本。

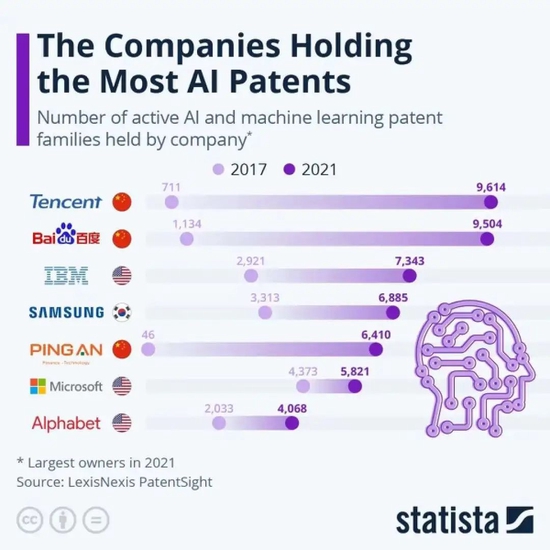

除此之外,像在专利储备上,根据statista2021年的数据,百度和腾讯都名列世界前列。

另一方面,就ChatGPT而言,它的技术原理并不新鲜。

Yann LeCun提到:“就底层技术而言,ChatGPT并不是特别创新的,它不是革命性的,尽管这是公众对它的看法。”他指出,除了谷歌和Meta,还有6家初创公司基本上拥有与它非常相似的技术。ChatGPT是一项集体努力,因为它汇集了多方多年来开发的多项技术。

李笛也提到,大模型对应的技术理念已经诞生好几年,无论是国内还是国外,使用这种技术理念训练出来的大模型已经很多,只是在具体fine tune(微调)的过程中专注的领域有所不同。

做个不恰当的比喻,ChatGPT就像原子弹一样,它的原理已经被写在了教科书里,而大多数国家仍然无法实现,更多是因为工程性的问题。比如千亿规模的数据从哪里来?如何进行数据标注,具体标注哪些数据,标注多少,这些数据又如何进行组织训练等等。

而这些问题也都没有在OpenAI的论文中得到公布,需要企业在自己的模型训练中去尝试和摸索,然后形成经验,积累成自己的know-how。

不要神化ChatGPT

虽然在底层技术上,国内外其实并没有想象中那么大的差距。但当大家看到国外如火如荼的技术落地时,也会担心国内在这方面掉队。

对于ChatGPT这样技术逻辑清晰的产品而言,慢一点并不影响结果。但如果产品差,则表现在具体工程问题的解决能力上,这些部分要摸索,要踩坑,要形成经验都需要漫长的时间,这背后反映的是技术水平的问题。

相比于欧美以英文为主的语言环境,中文是表意文字,在抽象概括和逻辑能力上天生不及英文。除此之外,国内互联网的语料也相对缺乏,没有英文互联网那么大的数据积累。

所以有业内人士表示,对目前国内的类ChatGPT产品发展而言,重要的不是模型,而是数据。

“自然语言处理需要经过一个非常严密的推理过程。”李笛提到:“大模型某种意义上代表一种暴力,即把大量的数据压缩到一个黑盒里面,然后提取出来,这意味着大家在算力有一定保障的前提下,可以有机会用之前没有用过的方法去完成。”

另一方面,ChatGPT确实是革命性的存在,但却并不代表它就是今后NLP领域的唯一方向。

首先是ChatGPT的技术发展,今天最主要的技术在于,一个模型建压好之后,如何从里面很好地提取数据,目前还有很多新方法没有尝试,所以不排除未来用更小的模型达到很好效果的可能。

李笛提到,现在整个行业都在追求这种可能,因为模型参数太大,一定意味着成本非常高,以及各种各样的其他问题。“今天技术差异还远远没有达到成为不同技术流派的程度,也还远远没有到说就按应用场景去划分这样一个程度。”

其次是从整个NLP的技术路线来看,目前主要有两种主流技术路线,分别是以谷歌BERT为代表的双向预训练语言模型+fine-tuning(微调),和以OpenAI的GPT为代表的自回归预训练语言模型+Prompting(指示/提示)。

在ChatGPT发布之前,BERT一直是业内主流的技术方案,它之所以被ChatGPT抢了风头,是因为它无法像GPT一样用一个模型解决所有问题,没有表现出通用型人工智能的潜力。

但实际上,BERT在许多具体的场景下拥有优势,比如在特定场景下,BERT可以用更小的数据量(ChatGPT是在3000亿单词的语料基础上预训练出的拥有1750亿参数的模型),更低的训练成本实现同样的性能。

比如在医院内部这样一个特定场景,一方面它用不起千亿规模的模型,ChatGPT在医院场景就属于杀鸡用牛刀,医院也无法负担部署ChatGPT的成本。另一方面,ChatGPT的模型是基于公开数据训练的,但医院的数据并不存在公共网络上,所以面对医院的问题,ChatGPT可能无能为力。

但BERT却能够适应这样的场景,它可以以更小的数据量,更低的成本,针对医院的数据和场景针对性地训练出的模型,在解决具体问题上比ChatGPT更加得心应手。

这其实就是一个所有领域都涉猎的全能型选手和深耕特定领域的专家之间的区别。即在数据确定的特定场景,BERT更有优势。而在没有明确数据和目标,面向开放式的应用场景,ChatGPT则更合适。

当然,具体到国内企业的商业化来说,大模型需要大量的数据,高昂的训练成本,这些都不是一般企业能够承担的,因此它注定了是巨头的游戏。

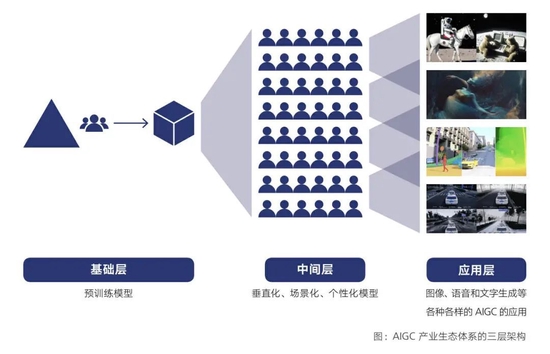

在腾讯研究院近期发布的《AIGC发展趋势2023》报告中就梳理了目前AIGC产业生态体系的三层构架,包括以预训练模型为主的基础层;以垂直化、场景化、个性化模型为主的中间层;和以图像、语音、文字生成等具体AIGC应用为主的应用层。

图:腾讯研究院《AIGC发展趋势2023》

其中,如百度、腾讯、OpenAI这样的大公司将专注于做预训练模型,对这些企业来说,他们一方面能够将大模型的能力整合到自己的产品线中,直接面向广大的用户;另一方面又能够通过API为中小企业提供能力调用,在具体场景中落地。

面对这样的生态架构,一位知名机构投资人在考察过硅谷的ChatGPT项目后向光锥智能表示:“创业公司的机会在于,在开源技术的基础上,做具体的应用场景。尤其是可以把几种具体技术结合在一起,比如数字人和ChatGPT结合,自动生成视频,用于金融、客服等特定场景下的应用。”

但这也会面临一些问题,即如果大家都调用同一个模型的能力,又落地在同一个细分场景,那必然会面临同质化的问题。

所以刘升平认为:“ChatGPT适合创业公司进入市场初期的冷启动,即通过ChatGPT提供服务,然后逐步积累数据,待有了一定数据积累之后再利用BERT训练专用模型,以此来建立自己的技术壁垒和护城河,同时也提供差异化的服务,和同行拉开差距。”

所以,无论是从技术,还是从商业化的角度而言,ChatGPT和BERT从来不是一个非此即彼的问题,而是一个术业有专攻的问题。

此外,刘升平也提到,对于中小公司而言,如果没有能力去研发类似ChatGPT的通用大模型,那也可以考虑研发类似ChatGPT的行业版模型,用更少的参数量,更多的行业数据,在行业问题上达到或超过ChatGPT的效果。

“我认为到目前为止,人工智能在To C和To B上尚未出现一个放之四海而皆准的商业模式。”

李笛提到,AI现在还出其实还处在一个相对比较早期,甚至可以称之为蛮荒时代,很多理念都还处在特别特别原始的状态,所以可能每年我们回顾过去,都会觉得在颠覆自己。

“就像前几年NIIPS大会上有人开玩笑说过的大模型炼丹,现在的大模型就像大家拿到了一个好的玩具,但不知道这个玩具还能吐出什么令人惊讶的东西。”

在2016年,AlphaGo击败李世石时,我们也曾以为AI时代已经来临,它会在许多领域将人类替代掉,我们也曾为此恐慌和兴奋,但实际上如今将近10年过去了,AlphaGo并没有改变世界,甚至没有改变任何人。

所以,何妨让子弹再飞一会儿呢?

(声明:本文仅代表作者观点,不代表新浪网立场。)